Fjala “ushtri” mungon në diskutimet për sigurinë e AI-së

Nga: Marietje Schaake / The Financial Times

Përkthimi: Telegrafi.com

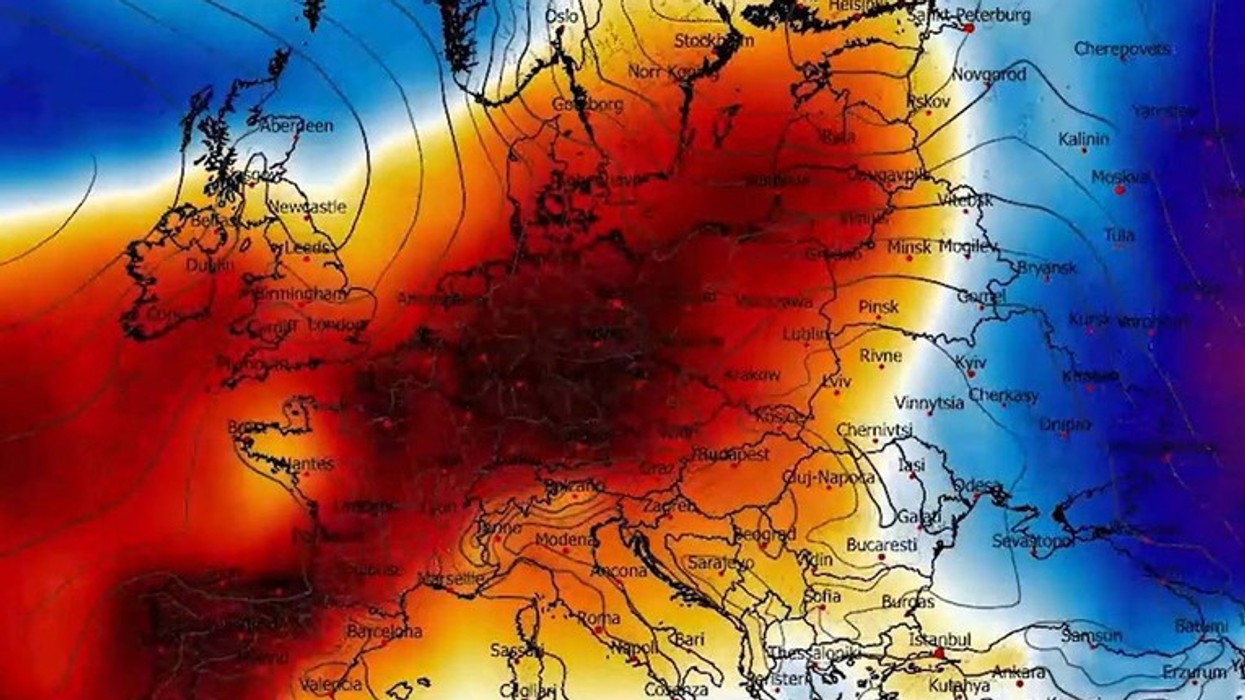

Qeveritë perëndimore janë duke garuar me njëra-tjetrën për të ngritur institutet e sigurisë së AI-së [inteligjencës artificiale]. Mbretëria e Bashkuar, ShBA-ja, Japonia dhe Kanadaja kanë njoftuar për nismat e tilla ndërkaq, javën e kaluar, Departamenti Amerikan i Sigurisë Kombëtare shtoi në përbërje një Bord për Mbrojtjen dhe Sigurinë e AI-së. Duke pasur parasysh këtë theks të madh mbi sigurinë, është e habitshme se si asnjëri nga këto organe nuk e rregullon përdorimin ushtarak të AI-së. Ndërkohë, fusha e betejës moderne tashmë po demonstron potencialin për rreziqet e qarta të sigurisë së AI-së.

Sipas një hetimi të fundit nga revista izraelite +972, Forcat Mbrojtëse të Izraelit [IDF] kanë përdorur një program të aktivizuar me AI, të quajtur Lavender, për të shënjuar objektivat për sulmet me dron. Sistemi kombinon të dhënat dhe burimet e inteligjencës për të identifikuar militantët e dyshuar. Programi dyshohet se identifikoi dhjetëra-mijëra objektiva dhe bombat e hedhura në Gazë rezultuan me vdekje dhe dëme të tepërta kolaterale. IDF-ja mohon disa aspekte të raportit.

Kapitalistët sipërmarrës po nxisin tregun "deftech" - ose të teknologjisë së mbrojtjes. Kompanitë e teknologjisë janë të prira të jenë pjesë e këtij bumi të fundit, ndërsa janë shumë të shpejta për të shitur përfitimet e AI-së në fushën e betejës. Raportohet se Microsoft-i për Ushtrinë amerikane ka zgjedhur Dalle-E-në, një mjet gjenerues të AI-së, ndërsa kompania kontroverse e identifikimit të fytyrës, Clearview AI, krenohet se ka ndihmuar Ukrainën që të identifikojë ushtarët rusë dhe teknologjinë e tyre. Anduril krijon sisteme autonome, ndërsa Shield AI zhvillon drone që drejtohen nga AI-ja. Të dy kompanitë morën qindra miliona dollarë në raundet e tyre të para të investimeve.

Por, edhe pse është e lehtë të drejtosh gishtin drejt kompanive private që reklamojnë AI-në për qëllime lufte, janë qeveritë ato që lejuan që sektori “deftech” t'i shpëtojë mbikëqyrjes së tyre. Akti historik i BE-së për AI-në nuk zbatohet për sistemet e AI-së të cilat janë "ekskluzivisht për qëllime ushtarake, të mbrojtjes ose të sigurisë kombëtare". Ndërkohë, Urdhri Ekzekutiv i Shtëpisë së Bardhë për AI-në kishte ndryshime të rëndësishme për AI-në ushtarake (megjithëse Departamenti i Mbrojtjes ka udhëzime të brendshme). Për shembull, zbatimi i pjesës më të madhe të Urdhrit të tij Ekzekutiv "nuk e mbulon AI-në kur përdoret si komponent i një sistemi të sigurisë kombëtare". Dhe, Kongresi nuk ka ndërmarrë asnjë veprim për të rregulluar përdorimet ushtarake të teknologjisë.

Kjo i lë të dy blloqet kryesore demokratike në botë, pa rregullat e reja detyruese se cilat lloje të sistemeve të AI-së mund të përdoren nga ushtria dhe nga shërbimet e inteligjencës. Prandaj, atyre u mungon autoriteti moral për të inkurajuar vendet e tjera që të vendosin kufizime rreth përdorimit të tyre të AI-së në ushtritë e tyre përkatëse. Një deklaratë e fundit politike mbi “përdorimin e përgjegjshëm ushtarak të inteligjencës artificiale dhe autonome”, që u mbështet nga një numër vendesh, nuk është asgjë më shumë se kaq: thjesht, një deklaratë.

Duhet të pyesim veten se sa kuptimplota janë diskutimet politike për sigurinë e AI-së, nëse ato nuk mbulojnë përdorimet ushtarake të teknologjisë. Pavarësisht mungesës së provave se armët e aktivizuara me AI mund të përputhen me ligjin ndërkombëtar, për veçimin dhe proporcionalitetin, ato shiten në mbarë botën. Meqenëse disa nga teknologjitë janë me përdorim të dyfishtë, janë të paqarta linjat midis përdorimeve civile dhe ushtarake.

Ka çmim njerëzor vendimi për të mos e rregulluar AI-në ushtarake. Edhe nëse ato janë sistematikisht të pasakta, këtyre sistemeve shpeshherë u jepet besimi i tepruar në kontekstet ushtarake, pasi gabimisht shihen si të paanshme. Po, AI-ja mund të ndihmojë në marrjen e vendimeve më të shpejta ushtarake, por gjithashtu mund të jetë më e prirë për gabime dhe në thelb mund të mos i përmbahet ligjit ndërkombëtar humanitar. Kontrolli njerëzor mbi operacionet është kritik në mbajtjen e akterëve në përgjegjësi ligjore.

OKB-ja është përpjekur të mbush boshllëkun. Sekretari i Përgjithshëm, António Guterres, për herë të parë bëri thirrje për ndalimin e armëve autonome në vitin 2018, duke i përshkruar ato si "moralisht të neveritshme". Më shumë se 100 vende kanë shprehur interesimin për të negociuar dhe miratuar ligjet e reja ndërkombëtare, për të ndaluar dhe për të kufizuar sistemet autonome të armëve. Por, Rusia, ShBA-ja, Britania e Madhe dhe Izraeli e kanë kundërshtuar propozimin detyrues, për çfarë dështuan bisedimet.

Nëse kombet nuk veprojnë për të mbrojtur civilët nga përdorimet ushtarake të AI-së, duhet të përforcohet sistemi ndërkombëtar i bazuar në rregulla. Trupi këshillues i nivelit të lartë i Sekretarit të Përgjithshëm të OKB-së për AI-në (në të cilin shërbej), do të ishte një nga disa grupet e përcaktuara mirë për të rekomanduar ndalimin e përdorimit të rrezikshëm të AI-së ushtarake, por udhëheqja politike mbetet jetike për të siguruar respektimin e rregullave.

Është tepër e rëndësishme që të sigurohemi se standardet e të drejtave të njeriut dhe ligjet e konfliktit të armatosur do të vazhdojnë të mbrojnë civilët në një epokë të re të luftës. Nuk mund të vazhdojë përdorimi i parregulluar i AI-së në fushën e betejës. /Telegrafi/