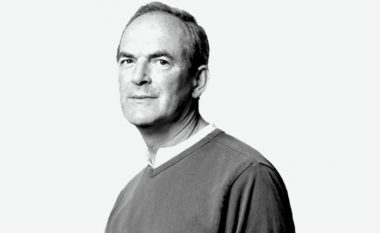

Nga: John Thornhill / The Financial Times

Përkthimi: Telegrafi.com

Një varg i gjatë i folësve prestigjiozë – duke filluar nga [kryeministri] William Gladstone në vitin 1892 – si Winston Churchill dhe Dame Iris Murdochu, kanë mbajtur ligjërata [Romanes Lecture] në Universitetin e Oksfordit.

Por, rrallëherë, ndoshta asnjëherë, ndonjë ligjërues ka bërë koment kaq rrëmbyes siç bëri Geoffrey Hinton në këtë javë. Fjalimi i studiuesit kryesor të inteligjencës artificiale, i titulluar në mënyrë provokative A do të zëvendësojë inteligjenca dixhitale inteligjencën biologjike?, përfundoi me fjalët: me siguri – po. Por, Hintoni e hodhi poshtë idenë e zakonshme të disa qarqeve teknologjike të Bregut Perëndimor, se humanizmi është disi “racist” kur vazhdon të pohojë përparësinë e specieve tona mbi format elektronike të inteligjencës. “Ne, njerëzit, duhet t’i bëjmë përpjekjet më të mira për të qenë pranë saj”, tha ai me shaka.

Shkencëtari britaniko-kanadez i kompjuterëve u bë i famshëm si një nga pionierët e teknikave të “të mësimit të thellë” [deep learning] që kanë revolucionarizuar AI-në [inteligjencën artificiale], duke mundësuar krijimin e çetbotëve gjenerues të AI-së, si ChatGPT. Për pjesën më të madhe të karrierës së tij akademike dhe në Google, Hintoni besonte se AI-ja nuk përbënte kërcënim për njerëzimin. Por, studiuesi 76-vjeçar thotë se vitin e kaluar e përjetoi një “epifani” dhe u largua nga Google për të folur rreth këtyre rreziqeve.

Hintoni e kuptoi se modelet gjithnjë e më të fuqishme të AI-në mund të veprojnë si “zgjua i mendjes”, duke ndarë atë që mësuan me njëri-tjetrin, duke ua dhënë atyre një avantazh të madh ndaj njerëzve. “Kjo më bëri të kuptoj se ato mund të jenë një formë më e mirë e inteligjencës”, më tha ai në një intervistë para ligjëratës së tij.

Duket ende e habitshme nëse linjat e kodit të softuerit mund të kërcënojnë njerëzimin. Por, Hintoni i sheh dy rreziqe kryesore. E para është se njerëzit e këqij do t’ua japin makinerive qëllimet e këqija dhe se do t’i përdorin ato për qëllime të këqija – si dezinformimi masiv, bioterrorizmi, lufta kibernetike dhe robotët vrasës. Në veçanti, modelet e inteligjencës artificiale me burim të hapur, si Llama e Meta-s, po i vendosin aftësitë e mëdha në duart e njerëzve të këqij. “Mendoj se është çmenduri të ofrosh këto modele të mëdha në burim të hapur”, thotë ai.

Por, ai parashikon se modelet gjithashtu mund të “evoluojnë” në mënyra të rrezikshme, duke e zhvilluar një qëllim për të kontrolluar. “Nëse do t’i këshilloja qeveritë, do të thosha se ka një shans me 10 për qind që këto gjëra ta zhdukin njerëzimin në 20 vitet e ardhshme. Mendoj se ky do të ishte numër i arsyeshëm”, thotë ai.

Argumentet e Hintonit janë sulmuar në dy fronte. Së pari, disa studiues argumentojnë se modelet gjeneruese të AI-së nuk janë asgjë më shumë se truke të shtrenjta statistikore dhe se rreziqet ekzistenciale nga teknologjia janë veçse “fantashkencë”.

Studiuesi i shquar Noam Chomsky argumenton se njerëzit janë të bekuar me një “sistem operativ” të instaluar gjenetikisht e që na ndihmon të kuptojmë gjuhën dhe që mungon në makineri. Por, Hintoni argumenton se kjo është e pakuptimtë, duke pasur parasysh se modeli më i fundit i OpenAI-së, GPT-4, mund të mësojë gjuhën dhe të shfaq ndjeshmëri, arsyetim dhe sarkazëm. “Po e bëj një pretendim të fortë se këto modele kuptojnë”, tha ai në ligjëratën e tij.

Linja tjetër e sulmit vjen nga Yann LeCun, shkencëtari kryesor i AI-së në Meta. LeCun – një mbështetës ky i modeleve me burim të hapur – argumenton se sistemet tona aktuale të inteligjencës artificiale janë më budallenj se macet dhe se është “marrëzi” të besohet se ato paraqesin kërcënim për njerëzit – qoftë nga qëllimi apo parazgjedhja. “Mendoj se Yann po tregohet paksa naiv. E ardhmja e njerëzimit varet nga kjo”, përgjigjet Hintoni.

Tonet e qeta dhe të matura të fjalimit të Hintonit janë në kontrast të plotë me fatalizmin e zymtë të mesazhit të tij. A mund të bëhet diçka për të përmirësuar shanset e njerëzimit? “Do të doja ta dija”, përgjigjet ai. “Nuk po e predikoj një zgjidhje të veçantë, thjesht po e predikoj problemin”.

Ai e mirëpriti samitin për sigurinë e AI-së të cilin Britania e Madhe vitin e kaluar e mbajti në Bleçli Park e që nxiti debat ndërkombëtar mbi këto politika. Por, që atëherë, thotë ai, qeveria britanike “në thelb vendosi se fitimet kanë më shumë rëndësi se siguria”. Ashtu si me ndryshimet klimatike, sugjeron se ndryshimi serioz i politikave do të ndodhë vetëm pasi të arrihet një konsensus shkencor. Dhe, pranon se ky konsensus sot nuk ekziston. Duke e cituar fizikanin Max Planck, Hinton shton me zymtësi: “Shkenca në të njëjtën kohë e zhvillon edhe një funeral”.

Ai thotë se është i kënaqur që një brez i ri i shkencëtarëve të kompjuterëve po e merr seriozisht rrezikun ekzistencial dhe sugjeron se 30 për qind e studiuesve të AI-së duhet t’i përkushtohen çështjeve të sigurisë – krahasuar me rreth një për qind që janë sot.

Instinktivisht duhet të jemi të kujdesshëm ndaj studiuesve që arrijnë në përfundimin se nevojiten më shumë kërkime. Por, në këtë rast, duke pasur parasysh rreziqet dhe pasiguritë e përfshira, më mirë të nxitojmë. Ajo që është e jashtëzakonshme në lidhje me debatin mbi rrezikun e AI -së është spektri i gjerë i pikëpamjeve. Duhet ta gjejmë një konsensus të ri. /Telegrafi/

Promo

Reklamo këtuLufta Prigozhin - Putin

Më shumë

"Është budalla, e rrah gruaja", Olta Gixhari flet për Luizin dhe BBVA: Gjysma e publikut ishin me mua, me të s'kam folur as kur kemi bërë filmin bashkë

Parashikimi i motit për të premten, shi, borë dhe erëra të furishme

Dërguti: Grupi i Osmanit në Guxo në bisedime për rikthimin në LDK, brenda dy ditësh dalin publikisht

Biden zhvlerësoi urdhrin e Gjykatës Ndërkombëtare për arrestimin e Netanyahut

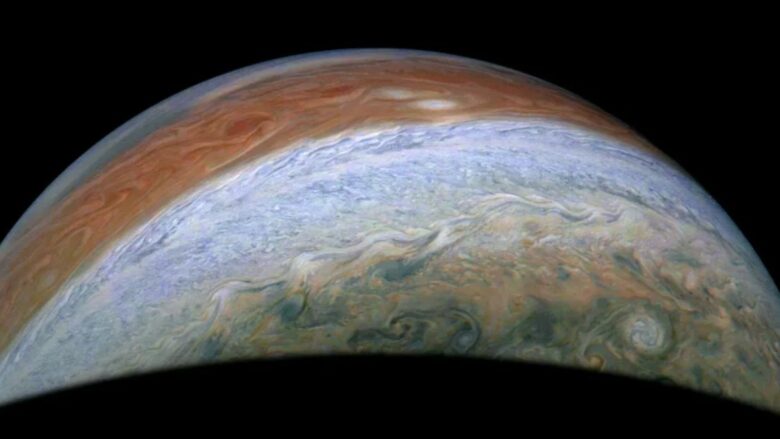

NASA publikoi foto të reja mahnitëse të Jupiterit

Pas tërheqjes së Gaetzit, Trump emëron një grua për Prokurore të Përgjithshme

104.5m² komfort – Banesë luksoze me pamje tërheqëse për zyret e juaja

Investoni në të ardhmen tuaj – bli banesë në ‘Arbëri’ tani! ID-140

Shitet banesa në Fushë Kosovë në një vendodhje perfekte – 80.5m², çmimi 62,000Euro! ID-254

Ideale për zyre – në qendër të Prishtinës lëshohet banesa me qira ID-253

Bli shtëpinë e ëndrrave tuaja në Prishtinë – ZBRITJE në çmim, kapni mundësinë tani! ID-123

25% zbritje në çizmet Adidas Terrex? Zgjate dorën!

Hej djem! Super xhaketa e Adidas tani vjen me zbritje ekskluzive vetëm për ju

Atletet e famshme Reebook vijnë me zbritje t’hatashme

Kreativiteti i fëmijëve tuaj fillon me këtë tabelë të zezë nga Vitorja – Përfitoni 20% zbritje ekskluzive

A don me u dok si zotni këtë sezon të dasmave?

Më të lexuarat

“Do më japësh një dy mijë lekësh të blej tost", babai i Martinit rrëfen mes lotësh bisedën e fundit me të birin

Pas urdhër-arrestit kundër tij, Netanyahu: Ditë e zezë për drejtësinë, nuk e njoh vendimin e gjykatës

"Është budalla, e rrah gruaja", Olta Gixhari flet për Luizin dhe BBVA: Gjysma e publikut ishin me mua, me të s'kam folur as kur kemi bërë filmin bashkë

Dërguti: Grupi i Osmanit në Guxo në bisedime për rikthimin në LDK, brenda dy ditësh dalin publikisht

Gjykimi i vëllezërve Vllasaliu në rastin e vrasjes së Bedri Rexhepit, dëgjohet biseda e përgjuar mes të pandehurve

Mes lotësh flasin për herë të parë prindërit e Martinit: Nuk duam hakmarrje

Nga Postman

Nga Postman

Nga MEKA HALAL FOOD

Nga MEKA HALAL FOOD

Nga Prishtina Ticket

Nga Prishtina Ticket

Nga AZTECH Electronics

Nga AZTECH Electronics