Inteligjenca gjeneruese Artificiale po i mbjell farat e dyshimit në shkencën serioze

Nga: Anjana Ahuja / The Financial Times

Përkthimi: Agron Shala / Telegrafi.com

Modelet e mëdha gjuhësore, si ChatGPT, janë ofrues të gjasave. Çetbotët, shumë prej të cilëve bazohen tek e ashtuquajtura Inteligjenca gjeneruese Artificiale (AI), janë trajnuar për t'iu përgjigjur pyetjeve të përdoruesve duke gërmuar në internet për informacionet përkatëse dhe duke i mbledhur përgjigjet koherente, duke nxjerrë ese bindëse për studentët, dokumente autoritare ligjore dhe lajme të besueshme.

Por, për shkak se të dhënat e disponueshme në publik përmbajnë keqinformime dhe dezinformime, disa tekste të krijuara nga makineria mund të mos jenë të sakta ose të vërteta. Kjo ka nxitur nevojën për veprime, për t’i zhvilluar mjetet për të kuptuar nëse teksti është hartuar nga njeriu apo nga makineria. Shkenca gjithashtu po përpiqet të përshtatet me këtë epokë të re, me diskutime të drejtpërdrejta nëse çetbotët duhet të lejohen t’i shkruajnë punimet shkencore apo të gjenerojnë hipoteza të reja.

Nga dita në ditë po shtohet rëndësia për dallimin e inteligjencës artificiale nga ajo njerëzore. Këtë muaj, analistët e UBS-it [bankë shumëkombëshe investimesh me qendër në Zvicër] zbuluan se ChatGPT ishte ueb-aplikacioni me rritjen më të shpejtë në histori, duke mbledhur 100 milionë përdorues aktivë mujorë në janar. Disa sektorë kanë vendosur se nuk ka kuptim të mbyllin derën ku pjese e sipërme është e hapur: të hënën, nga International Baccalaureate [programi që në mënyrë akademike sfidon nxënësit - zakonisht të moshës 16-19-vjeçare - me objektivin që të përgatiten për të pasur sukses në universitet] thanë se nxënësit do të lejohen të përdorin ChatGPT-in për të shkruar ese, me kushtin që t'i referohen asaj.

Në mënyrë të paanshme, krijuesi i teknologjisë është i përgjegjshëm për kufizimet. Sam Altman, shefi ekzekutiv i OpenAI, në dhjetor paralajmëroi se ChatGPT ishte "mjaft i mirë në disa gjëra për ta krijuar përshtypjen mashtruese të madhështisë ... kemi shumë punë për të bërë për qëndrueshmërinë dhe për vërtetësinë”. Kompania po zhvillon sistemin për identifikimin e autorësisë në rezultate [cryptographic watermark], një sekuencë sekrete e leximit - përmes makinerisë - të shenjave të pikësimit, të drejtshkrimit dhe renditjes së fjalëve; dhe se po e përmirëson një "klasifikues" për ta treguar dallimin midis tekstit sintetik dhe atij të krijuar nga njeriu, duke përdorur shembuj të të dyjave për ta trajnuar atë.

Eric Mitchell, student i diplomuar në Universitetin e Stanfordit, mendoi se klasifikuesi do të ketë nevojë për më shumë të dhëna trajnimi. Së bashku me kolegët, doli me DetectGPT, një qasje "zero-shot" [aftësia për të përfunduar një detyrë pa marrë ndonjë shembull trajnimi] për ta dalluar ndryshimin, që do të thotë se metoda nuk kërkon mësim paraprak. Në vend të kësaj, metoda e kthen çetbotin te vetvetja, për ta nuhatur rezultatin e vet.

Funksionon kështu: DetectGPT e pyet një çetbot se sa "i pëlqen" teksti mostër, pastaj me "pëlqimin" e një stenografie se sa e ngjashme është mostra me krijimet e veta. DetectGPT pastaj shkon një hap më tej - e "turbullon" tekstin, duke e ndryshuar pak formulimin. Supozimi është se çetboti është më i ndryshueshëm në "pëlqimet" e veta për tekstin e ndryshuar e të krijuar nga njeriu sesa nga teksti i ndryshuar nga makina. Në testet e hershme, studiuesit pretendojnë se në 95 për qind të rasteve metoda e dallonte saktësisht autorësinë njerëzore me atë të makinerisë.

Janë disa kufizime: rezultatet nuk janë shqyrtuar ende nga akademikët; metoda, megjithëse më e mirë se hamendja e rastësishme, nuk funksionoi në mënyrë të njëjtë të besueshme në të gjitha modelet gjeneruese të AI-së. DetectGPT mund të mashtrohet duke bërë përshtatje njerëzore në tekstin sintetik.

Çfarë do të thotë gjithë kjo për shkencën? Botimi shkencor është gjaku i kërkimit, duke injektuar ide, hipoteza, argumente dhe prova në sistemin global shkencor. E, disa kanë qenë të shpejtë që të zbresin te ChatGPT-ja si asistent kërkimor, me një pjesë të vogël të dokumenteve që e renditin AI-në si bashkautor.

Meta madje lansoi një gjenerator specifik shkencor të tekstit të quajtur Galactica. U tërhoq tre ditë më vonë. Ndër gabimet trashanike që prodhoi ishte historia fiktive e arinjve që udhëtonin në hapësirë.

Profesori Michael Black i Institutit Max Planck për Sistemet Inteligjente në Tubingen [të Gjermanisë], atë kohë shkroi në rrjetin Twitter se ishte "i shqetësuar" nga përgjigjet e Galactica-së për pyetjet e shumta rreth fushës së tij kërkimore, përfshirë atribuimin e dokumenteve false ge studiuesit e vërtetë. “Në të gjitha rastet [Galactica] gabonte ose ishte e njëanshme, por tingëllonte si e drejtë dhe autoritare. Mendoj se është e rrezikshme”.

Rreziku vjen nga teksti i besueshëm që rrëshqet në parashtresa të vërteta shkencore, duke e mbushur literaturën me citate të rreme dhe duke e shtrembëruar përgjithmonë standardin. Revista Science tashmë e ndalon tekstin krejtësisht të gjeneruar; Natyre e lejon përdorimin e tij nëse deklarohet, por e ndalon vlerësimin si bashkautor.

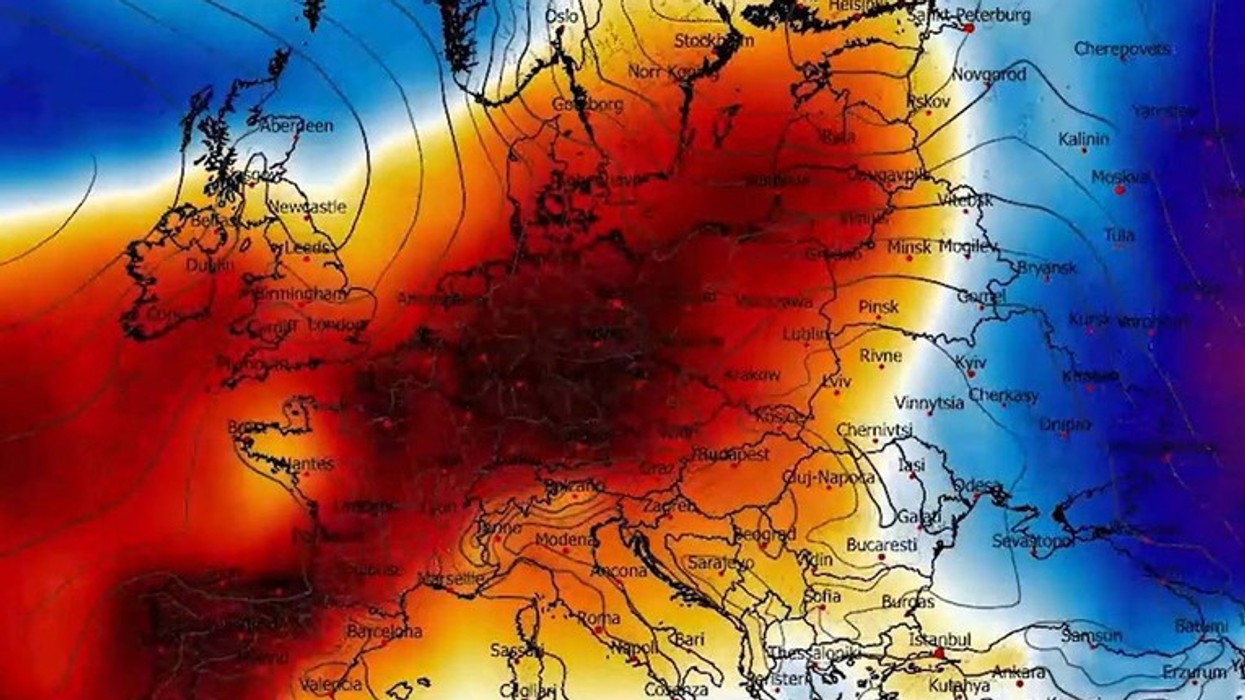

Prapë se prapë, shumica e njerëzve nuk konsultohen me revistat e nivelit të lartë për ta drejtuar mendimin shkencor. Nëse dredharakët janë kaq të nënshtruar, këta çetbotë, sa herë që kërkohet, mund ta vjellin rrymën e pseudoshkencës, me citimet e shumta se pse vaksinimi nuk funksionon ose pse ngrohja globale është mashtrim. Ky material mashtrues, i postuar në internet, më pas mund të gëlltitet nga AI-të e ardhshme gjeneruese për të prodhuar përsëritjen e re të gënjeshtrave që ndotin më tej diskursin publik.

Tregtarët e dyshimit mbase po i fërkojnë duart. /Telegrafi/